أتذكر عندما كنت صغيرة؛ في فترة الهواتف القديمة «الموبايلات الزراير» وقد جبت أنحاء الإنترنت بحثًا عن اسم عربي رسمي لذلك النوع من الهواتف ولم أجد. في تلك الفترة انتشرت العديد من مقاطع الفيديو الغريبة التي تبث الرعب في قلوب من يراها، نظرًا لغرابتها، وكان ذو وعي حينها يطلق عليها «فيديوهات فوتوشوب» رغم أن الفوتوشوب للصور فقط وليس الفيديو!

كان التزوير والتلاعب بالصور والفيديوهات في تلك الفترة مصدر قلق وهلع كبير للكثيرين؛ إذ خشي العديد من الأشخاص، وبالأخص الفتيات، من أن تُحرف صورهم باستخدام الفوتوشوب لتدمير حياتهم. وقد وقعت هذه الحوادث بالآلاف، لكن مع الوعي العالمي تحول الأمر في النهاية إلى مادة كوميدية.

إذا كنت من متابعي مسلسلات رمضان، عزيزي القارئ؛ ففي إحدى حلقات مسلسل «يوميات زوج معاصر» للفنان أشرف عبد الباقي؛ تلاعب أحد الكارهين له بصورة؛ إذ وضع وجهه على جسم شخص في يوم زفافه بجانب امرأة غير زوجته للإيقاع بينهما؛ وشككت زوجته في الصورة لأن لون يد العريس في الصورة سوداء؛ بينما يد عبد الباقي بيضاء.

ومع ظهور الذكاء الاصطناعي؛ حدثت موجة عالمية جديدة تضم المخاوف من التلاعب بالصور أيضًا؛ لكن الذكاء الاصطناعي الآن يمكنه تقليد صوتك وتوليد صورتك في أي وضع؛ بل وفيديو يتضمنك أيضًا. تسبب ذلك بمخاوف عالمية من جرائم الذكاء الاصطناعي. لكن الأمر لا يقتصر على التوليد البصري فقط؛ ففي الواقع، يوجد العديد من أدوات الذكاء الاصطناعي في الدارك ويب، التي تمكن أي شخص من فعل أي شيء طالما لديه الوصول لتلك الأدوات وبالطبع كيفية استخدامها وتوظيفها في الأهداف المرجوة.

وفي موقف قريب؛ وقع حادث مأساوي على الطريق الدائري بالقاهرة، مصر؛ إذ بدأ الحادث عندما اصطدمت سيارة نقل محملة بالرمال بسيارة نقل أخرى؛ ما أدى إلى تدخل سيارة نقل ثالثة في الحادث. تصاعدت الأحداث بسرعة، ليسفر الحادث عن تصادم 22 سيارة وإصابة نحو 24 شخصًا. ورغم فداحة الحادث، فما تلاه من أحداث على وسائل التواصل الاجتماعي كان له تأثير أكبر. حين شارك شخص ما صورة لحادث أكثر ترويعًا، وانتشرت بسرعة كبيرة عبر منصات التواصل الاجتماعي؛ إذ وصل الأمر إلى مشاركة بعض الشخصيات العامة والمشهورة لهذه الصورة؛ ما زاد من نطاق انتشارها بشكل كبير.

لاحقًا، كشفت إحدى الصحف أن الصورة المتداولة كانت في الواقع من إنتاج الذكاء الاصطناعي؛ فإلى أي مدى يأخذنا الذكاء الاصطناعي؟ هل نشك حتى في الواقع؟ هل نبدأ بتبادل التهم عن واقعية أو زيف كل ما هو مرأي على الإنترنت؛ وعلى وجه الخصوص مواقع التواصل الاجتماعي؛ والتي أصبحت وجهه هامة للجميع للالتقاط أخبار العالم!

في هذا المقال سنغوص في الظلام؛ في الجانب المرعب والمخيف للذكاء الاصطناعي، في مكان حيث يمكن أن يكون أسوأ كوابيس أحدهم!

لو اجتهد المجرم في حياته قدر ما اجتهد في الجريمة!

الذكاء الاصطناعي، مع تقدمه المذهل، أحدث طفرة في الإنتاجية عبر مختلف المجالات، بما في ذلك، للأسف، عالم الجريمة. وفقًا لفينتشينزو سيانكاجليني، الباحث البارز في شركة «تريند مايكرو» للأمن السيبراني، فإن هذه التقنيات الجديدة والقوية قد مكنت الجهات الخبيثة من العمل بكفاءة أعلى وعلى نطاق عالمي غير مسبوق.

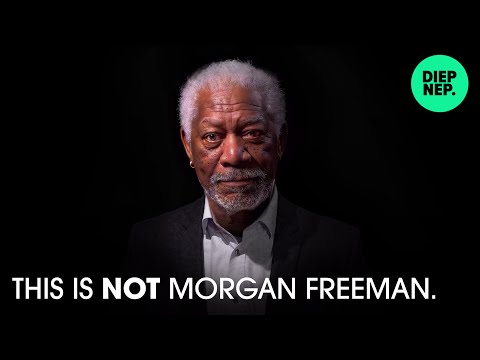

ويشير سيانكاجليني إلى حقيقة مهمة؛ وهي أن معظم المجرمين ليسوا شخصيات نمطية تعيش في الظلام، بل هم أفراد عاديون يسعون لتحسين إنتاجيتهم في أنشطتهم غير القانونية، تمامًا كما يفعل الآخرون في أعمالهم المشروعة. فمع التطور الهائل في تقنيات تزييف الفيديو، أصبحت الصور المزيفة أيضًا أكثر إتقانًا وإثارة للخوف؛ إذ يتطلب الكشف عن الأخطاء الدقيقة التي قد ينتجها الذكاء الاصطناعي مستوى أعلى من اليقظة والتدقيق، والتي ربما لا تلحظها العيون غير المدربة، خاصةً في الصور عالية الجودة.

ومع ذلك، فإن التكنولوجيا نفسها تقدم حلولًا لمواجهة هذه التحديات. فقد طوُرت العديد من الأدوات المتخصصة في كشف المحتوى المزيف أو المُعدّل بواسطة الذكاء الاصطناعي، سواءً كان ذلك في الفيديو أو الصور؛ إذ تُمثل هذه الأدوات خط دفاع مهم في مواجهة انتشار المعلومات المضللة والمحتوى المزيف.

اختبار لتمييز الصور الحقيقية عن الذكاء الاصطناعي

كيف تنشأ الأدوات الضارة – الوجه الشرير من الإنترنت

نشأت شبكة الويب العميقة (الديب ويب) عرضيًا نتيجة لقصور محركات البحث الأولى. فعند إنشائها، لم تتمكن هذه المحركات من فهرسة جميع المواقع الإلكترونية؛ ما أدى إلى وجود العديد من الصفحات غير المسجلة والتي لا يمكن الوصول إليها عبر محركات البحث التقليدية. ورغم أن الديب ويب ليس شريرًا بطبيعته، مهد وجوده الطريق لظهور «الدارك ويب»، وهو الجانب المظلم الذي يضم عالم الجريمة المشفرة.

بعد ثورة ChatGPT-3.5 العام الماضي ظهر أكثر من نموذج ذكاء اصطناعي ضار أبرزهم؛ WormGPT وهو نموذج مبني على GPT-J مفتوح المصدر الذي طورته مجموعة الأبحاث المفتوحة EleutherAI في عام 2021. يتميز WormGPT عن النموذج الأصلي بغياب أي قواعد أو قيود أخلاقية. وادعى مطوروه أنهم دربوه على مجموعة متنوعة من البيانات، مع التركيز على المعلومات المتعلقة بالبرمجيات الخبيثة، بهدف مساعدة القراصنة في هجماتهم الإلكترونية.

لكن سرعان ما أعلن المطورون إيقاف المشروع بعد جذبه اهتمامًا إعلاميًا واسعًا، كما تراجع اهتمام المجرمين الإلكترونيين بتطوير نماذج ذكاء اصطناعي خاصة بهم. ويرجع ذلك جزئيًا إلى التطور السريع في مجال الذكاء الاصطناعي؛ إذ أصبحت النماذج القديمة مثل GPT-J متقادمة بسرعة. بالإضافة إلى أن محاولات تطوير نماذج خاصة عوائق تواجه كبيرة تشمل التكاليف الباهظة، ومتطلبات الأجهزة المتقدمة، والقيود القانونية.

وبدلاً من ذلك، اتجه المجرمون الإلكترونيون إلى استغلال الأدوات القائمة بالفعل والتي تعمل بشكل موثوق. لكن مع وجود نماذج مفتوحة المصدر وقوية مثل Llama من ميتا، وGemma من جوجل، سيُفتح لهم إمكانيات جديدة لتطوير أدوات متقدمة للجرائم الإلكترونية.

يشير الباحث سيانكاجليني إلى أن المجرمين يميلون عادةً إلى البحث عن حلول سهلة ومكاسب سريعة. لذا؛ فإن تبني أي تقنية جديدة يجب أن يوفر مزايا واضحة تفوق المخاطر المحتملة، مثل زيادة احتمالية الكشف والقبض عليهم. وهذا يفسر سبب تردد العديد من المجرمين في الاعتماد على تقنيات الذكاء الاصطناعي الحديثة، مفضلين الاستمرار باستخدام الأساليب التقليدية الأكثر أمانًا من وجهة نظرهم.

الدوبلير التقني!

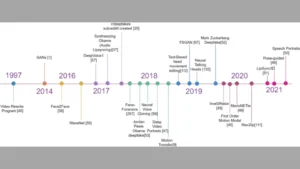

في 2014؛ طوُرت تقنية إصدار الشبكات التوليدية التنافسية (GANs)، وهي إطار عمل للتعلم الآلي يتكون من نظامين من الشبكات العصبية يتنافسان مع بعضهما البعض؛ شبكة عصبية تحاول إنتاج بيانات اصطناعية وشبكة عصبية تحاول التمييز بين البيانات الحقيقية والبيانات المزيفة. كانت تلك التقنية ثورية حينها، واستخدمت في العديد من الأفلام لتغيير سن الممثلين، مثل تجديد شباب مايكل دوجلاس وروبرت داوني جونيور في أفلام مارفل.

يمكن للذكاء الاصطناعي الآن محاكاة تعابير الوجه وحركات الشفاه والأصوات بدقة متناهية. ليصبح قادرًا على التلاعب بالصور، والفيديوهات والتسجيلات الصوتية وتزييفها لتبدو واقعية بشكلٍ مذهل.

في حين أن لهذه التقنية فوائد جمة في مجال صناعة الأفلام والترفيه، لكن من وجهة نظري المتواضعة، أجد أن مخاطرها تفوق منافعها بكثير. قد يستطيع قطاع الترفيه الاستغناء عنها، لكن ماذا عن تأثيراتها في حياتنا اليومية؟ يعج اليوتيوب بمقاطع فيديو DeepFake مرفقة بدليلك لكيفية استخدامها بأقل المكونات! إذ يكفي توفر صورة شخص وفيديو آخر ليدمجهما الذكاء الاصطناعي بسلاسة. أدت هذه السهولة في الإنتاج والانتشار الواسع إلى استخدام هذه التقنية في التضليل الإعلامي والاحتيال على نطاق مقلق. إنه لأمر مرعب أن لا تتمكن من التمييز بين الواقع والتزييف!

وفقًا لتقرير نشرته مجلة فوربس، أظهر 52% فقط من الموظفين ثقة تامة في قدرتهم على التعرف على مديرهم التنفيذي. هذا يعني أن نحو نصف الموظفين قد يكونون عرضة للخداع أو الاحتيال باستخدام تقنيات مثل التزييف العميق.

في تطور مثير في مجال الذكاء الاصطناعي التوليدي، ظهرت تقنية تُمكّن النموذج المُدرب من إنشاء مقاطع فيديو كاملة باستخدام الأوامر النصية فقط. يجمع هذا الابتكار بين الإبهار والقلق. ويبرز نموذج Sora من شركة OpenAI كرائد في هذا المجال؛ إذ يقدم مستوى غير مسبوق من الواقعية في توليد الفيديو.

ورغم استمرار وجود بعض العيوب صعبة الملاحظة في الفيديوهات المولدة، والتي قد تسبب بعض الانزعاج للمشاهدين، يبقى التطور ثوريًا. تعرف تلك الظاهرة بـ (Uncanny Valley) وهي ظاهرة نفسية تشير إلى الاستجابة السلبية التي يشعر بها الناس تجاه الأشياء التي تبدو شبه إنسانية ولكنها ليست إنسانية تمامًا. يتعلق الأمر بالأشياء التي تقترب من شكل الإنسان أو سلوكه، مثل الروبوتات أو الشخصيات الرقمية، ولكنها تظل غير طبيعية أو غريبة بعض الشيء.

في الوقت الحالي، هناك طريقتان رئيسيتان لتزييف الفيديوهات؛ الأولى هي التوليد الكامل باستخدام الذكاء الاصطناعي، والثانية هي تقنية الـDeepfake التي تسمح باستبدال وجه شخص بوجه شخصٍ آخر. فيمكن لأي شخص لديه وصول لتلك الأدوات تسجيل فيديو يفعل فيه ما شاء ثم يضع وجه شخص آخر مكان وجهه فيصبح الفيديو له ببساطة!

ومع تدفق أدوات الذكاء الاصطناعي في السوق، زادت عمليات التزوير المتقدم وحيل التصيد؛ إذ وفقًا للإحصائيات شهدت الفترة بين عامي 2019 و2020 زيادة هائلة في المحتوى المزيف على الإنترنت بنسبة 900%. ويتوقع الخبراء وفقًا للمنتدى الاقتصادي العالمي أن يصل 90% من المحتوى الرقمي إلى كونه مُنتجًا بواسطة الذكاء الاصطناعي بحلول عام 2026.

أدى هذا التطور السريع إلى ظهور تحديات أمنية جديدة؛ ففي عام 2022، واجه 66% من محترفي الأمن السيبراني هجمات ديب فيك داخل منظماتهم. من الأمثلة على هذه الهجمات، إنشاء رسائل صوتية مزيفة من الرؤساء التنفيذيين أو كبار المسؤولين في الشركات. وتحتوي هذه الرسائل الصوتية المُزيفة غالبًا على طلبات عاجلة من المتلقي لتحويل الأموال أو الكشف عن معلومات حساسة.

ورغم استمرار وجود بعض العيوب صعبة الملاحظة في الفيديوهات المولدة، والتي قد تسبب بعض الانزعاج للمشاهدين، يبقى التطور ثوريًا. تعرف تلك الظاهرة بـ (Uncanny Valley) وهي ظاهرة نفسية تشير إلى الاستجابة السلبية التي يشعر بها الناس تجاه الأشياء التي تبدو شبه إنسانية ولكنها ليست إنسانية تمامًا. يتعلق الأمر بالأشياء التي تقترب من شكل الإنسان أو سلوكه، مثل الروبوتات أو الشخصيات الرقمية، ولكنها تظل غير طبيعية أو غريبة بعض الشيء.

وقد وصلت خطورة هذه التقنيات إلى مستويات غير مسبوقة. ففي أبريل 2024، وقعت حادثة مثيرة للقلق في هونج كونج؛ إذ تمكن محتالين إلكترونيين استخدموا تقنية التزييف العميق من خداع عامل مالي في شركة متعددة الجنسيات لدفع 25 مليون دولار، من خلال التظاهر بأنهم المدير المالي للشركة خلال مكالمة فيديو. شهدت عملية الاحتيال إقناع العامل بحضور مكالمة فيديو مع ما ظنه عدة أعضاء آخرين في الفريق، لكنهم في الواقع كانوا جميعًا إعادة إنشاء باستخدام تقنية التزييف العميق.

في الآونة الأخيرة، تكررت هذه الحادثة بشكلٍ ملحوظ. ونظرًا لخطورة الوضع، يوصي الخبراء بأن تتفق الجهات المعنية والأصدقاء وأفراد العائلة على استخدام كلمة أمان متغيرة للتحقق من هوياتهم الحقيقية. ويهدف الإجراء رغم غرابته إلى تعزيز الأمان وتجنب الوقوع ضحية للانتحال أو الخداع.

الجريمة أسهل والحياة أصعب

تسبب كنز المعلومات على الإنترنت في وجود نماذج الذكاء الاصطناعي القوية التي نشهدها اليوم. لكن هذا التقدم يحمل في طياته مخاطر كبيرة؛ إذ نشأ عالم موازٍ من البيانات المسروقة القابلة للاستغلال في الأنشطة الإجرامية. تشمل هذه البيانات مليارات السجلات المسروقة، بدءًا من أرقام الضمان الاجتماعي وكلمات المرور لمختلف الحسابات (خاصةً البنكية)، مرورًا بالمعلومات الصحية، وصولًا إلى أرقام لوحات السيارات.

في عام 2021؛ كُشف عن 4,145 خرقًا علنيًا تعرض فيه أكثر من 22 مليار سجل للاختراق، في حين سجل عام 2020 نحو 37.2 مليار سجل مخترق!

في الماضي القريب؛ كانت قدرة المجرمين على استغلال هذه المعلومات محدودة بسبب قيود الوقت والأدوات المتاحة. لكن مع ظهور الذكاء الاصطناعي، تغير المشهد بشكلٍ جذري؛ إذ أصبح من الممكن فرز مليارات السجلات بسهولة، مع تلاشي أحد أكبر التحديات الإجرامية أمامهم، وهو إيجاد الروابط بين قطع المعلومات المتناثرة. فمن خلال تحليل البيانات لإيجاد الأجزاء المتطابقة أو المترابطة؛ يمكنهم تكوين صورة كاملة عن ضحاياهم المحتملين.

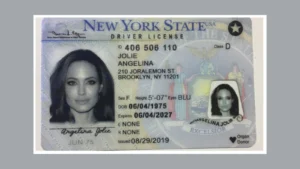

وجود هذا الكم الهائل من البيانات، مقترنًا بقدرات الذكاء الاصطناعي، يسهل عملية سرقة الهوية بشكلٍ كبير؛ إذ يمكن للذكاء الاصطناعي إنشاء محتوى مخصص يبدو أصيلًا؛ ما يزيد من فرص نجاح عمليات الاحتيال. وفقًا لتقرير شركة Sumsub المتخصصة في التحقق من الهويات، شهد عام 2023 ارتفاعًا هائلًا في عمليات الاحتيال باستخدام تقنية التزييف العميق؛ إذ ارتفعت بنسبة 1740% في أمريكا الشمالية و450% في منطقة الشرق الأوسط وأفريقيا.

وربما تتسائل ما علاقة الهوية المزيفة بالتزييف العميق؟ في الواقع تُعد العلاقة بين المعلومات المسربة وتقنيات التزييف العميق تكاملية؛ فالمعلومات الحقيقية تجعل عمليات الاحتيال أكثر تخصيصًا وإقناعًا، فالتمييز بين الهويات الحقيقية والمزيفة عند استخدام بيانات حقيقية مع وسائط مزيفة عالية الجودة، صعب جدًا.

في الماضي؛ كانت هجمات التصيد الاحتيالي أسهل في الكشف لأنها تتطلب مهارات احترافية لتقليد الجهات الموثوقة بلغة سليمة. لكن مع ظهور تقنيات الذكاء الاصطناعي مثل ChatGPT، تغير الوضع بشكلٍ مثير؛ إذ خلال عام واحد من إطلاق ChatGPT، لوحظت زيادة بنسبة 1265% في رسائل التصيد الاحتيالي، مع ارتفاع بنسبة 1000% في محاولات سرقة بيانات الاعتماد، بما في ذلك أسماء المستخدمين وكلمات المرور ورموز الأمان المؤقتة (OTP) وغيرها من البيانات الحساسة.

وأصبح من السهل على المجرمين إنشاء وإطلاق وإدارة حملات البريد العشوائي والتصيد الضخم، والتي تكون مدروسة ومُقنعة لدرجة أنها تكاد تكون من المستحيل اكتشافها. كما أن ترجمة رسائل التصيد ورسائل البريد الإلكتروني التجارية المفخخة إلى لغاتٍ متعددة، يمكن للذكاء الاصطناعي تنفيذه في أقل من دقيقة، فعائق اللغة والصياغة والأسلوب لم يعد عقبة بعد الآن.

وفي سيناريو خيالي؛ جمعك عمل مع شخص ما أردت التحقق من هويته؛ يمكن للذكاء الاصطناعي إنشاء ملفات تعريف وتواريخ على الإنترنت مفصلة وموثوقة، بدءًا من المواقع المهنية إلى الملفات الشخصية، وصفحات LinkedIn، وسجلات العمل، وحتى الشهادات. ويمكن لأدوات الذكاء الاصطناعي إنشاء مواقع ويب واقعية في غضون دقائق، سواء لتزوير هوية المجرم، أو كواجهة لعرض وظائف احتيالية.

تشفر معظم المواقع كلمات المرور الخاصة بها، لذا؛ عند سرقة بيانات ذلك الموقع تصبح كلمات المرور مجموعة من الكلمات السرية المشفرة. لكن برمج مطوري الجانب المظلم أدوات متقدمة لكسر كلمات المرور «فك التشفير»؛ إذ يمكن لتلك الأدوات كسر 51% من كلمات المرور الشائعة في أقل من دقيقة، و65% في أقل من ساعة، و71% في أقل من يوم، وأقل من شهر لاختراق 81% منها.

تُقدر أبحاث Juniper أن الخسائر العالمية من الاحتيال في التجارة الإلكترونية من 2023 إلى 2027 ستتجاوز 343 مليار دولار. ومن المحتمل أن تقسم هذه الخسائر بين الشركات والمستهلكين.

تقدم على عدوك ألف خطوة إذا استطعت

تمكنت شركة HYAS، بس شركة أمن سيبراني متخصصة في مجال استخبارات التهديدات والكشف عن الهجمات، من تطوير نموذج BlackMamba، وهو نموذج ذكاء اصطناعي لتوليد برمجيات خبيثة (Malware) بقدرات متقدمة. يُعد هذا النموذج نوعًا متقدمًا من البرمجيات الخبيثة يسمى “سجل المفاتيح البوليمورفي” (polymorphic keylogger)، ويعمل على تسجيل كل ما يكتبه المستخدم على لوحة المفاتيح.

يتميز BlackMamba بأنه يستخدم الذكاء الاصطناعي لتوليد شيفرة خبيثة ديناميكيًا أثناء وقت التشغيل، تمكنه هذه القدرة من تعديل شيفرته باستمرار وبطرق غير متوقعة؛ ما يجعل اكتشافه من قِبل أنظمة الأمان أمرًا بالغ الصعوبة. كما يعمل البرنامج دون الحاجة إلى بنية تحتية تقليدية للتحكم والقيادة، مستخدمًا بدلًا من ذلك قنوات اتصال موثوقة مثل API الخاصة بـ OpenAI للحصول على الشيفرة الخبيثة.

عند إصابة جهاز ما، يبدأ BlackMamba في جمع معلومات حساسة؛ مثل كلمات المرور وأرقام بطاقات الائتمان من خلال تسجيل ضربات المفاتيح. ثم يصدر هذه البيانات عبر منصات شائعة الاستخدام مثل Microsoft Teams للخارج؛ إذ يمكن استغلالها في أنشطة غير قانونية كالبيع في السوق السوداء أو استخدامها في عمليات اختراق إضافية.

رغم الطبيعة المقلقة لهذا التطور، فإن الهدف من هذه الأبحاث هو تعزيز الحماية السيبرانية؛ إذ تدرك شركات الأمن السيبراني أن ما توصلت إليه اليوم قد يصبح في متناول المجرمين الإلكترونيين غدًا. لذا؛ فإن الحاجة مُلحة لزيادة الاستثمارات في مجال الأمن السيبراني لمواجهة هذه التهديدات المتزايدة. ومع توفر الإمكانيات والموارد اللازمة، فإن تلك الاستثمارات من شأنها أن توفر حماية فعالة ضد التهديدات المستقبلية، وهو ما يفتقر إليه المجرمون الإلكترونيون عادةً.

كل ما نتواصل به بحاجة للتوثيق

في أغسطس 2024؛ حكم على المجرم، نيل دارلينجتون، بالسجن ثلاث سنوات، وهو حكم مخفف وحقير جدًا؛ إذ تلاعب المجرم بصور أطفال «فتيات» بالذكاء الاصطناعي لتحويلها إلى محتوى جنسي لإبتزازهم من خلال تهديده لهن بإرسال الصور إلى عائلاتهن وأصدقائهن أيضًا.

الإنترنت يومًا بعد يوم يصبح مكانًا خطرًا على الأطفال؛ إذ يتطلب الأمر توعيتهم للكثير من الجرائم التي يمكن أن تمارس في حقهم على الإنترنت. وهو ما لا يحتمله عقل طفل، فالمخاطر أصبحت أكثر من إدراك حتى الكبار منّا، فنحن نستخدم الإنترنت بحرص طوال الوقت! فضغطه ساذجة واحدة يمكن أن تودع بياناتك بعدها.

أصبحت منصات التواصل الاجتماعي ساحة رئيسية لعمليات الابتزاز بشتى أنواعه باستخدام الذكاء الاصطناعي، سواء عبر الصور أو الفيديوهات أو التسجيلات الصوتية المزيفة. حيث تجعل سهولة الوصول للضحايا والأعداد الهائلة من المستخدمين من هذه المنصات هدفًا مغريًا للمجرمين لاستهدافهم من خلال معلوماتهم، كالجنس والسن والمنطقة الجغرافية مثلًا.

ونظرًا لوجود مليارات البشر على تلك المنصات، يقع على عاتقها مسؤولية جسيمة في حماية مستخدميها من الجرائم الإلكترونية وآثارها السلبية على الصعيد النفسي والاجتماعي والمادي أيضًا. ومن الحلول الفعالة لتحقيق هذه الحماية هو تطبيق نظام العلامات المائية أو الإشارات المميزة على الصور والوسائط المُرسلة أو المنشورة عبر هذه المنصات. فمثل هذا الإجراء من شأنه أن يخفف من حدة التهديدات المحتملة؛ إذ يمنح المستخدمين فرصة لتدارك الموقف والتصرف بحكمة عند مواجهة محاولات الابتزاز أو الاستغلال.

لمواجهة هذه التحديات، تأسس تحالف إثبات المحتوى والأصالة (C2PA) من قِبل شركات رائدة مثل إنتل وميكروسوفت وأدوبي والمنصة الإعلامية BBC وشركة الذكاء الاصطناعي الرائدة OpenAI. يهدف هذا التحالف إلى تطوير معايير تقنية لتوثيق مصدر وتاريخ المحتوى الإعلامي؛ إذ يعمل بروتوكول C2PA على حفظ بيانات الصورة، مع تسجيل كافة التعديلات في مستند مُدمج مع الصورة يُمكن الاطلاع عليه في أي وقت؛ وذلك من خلال وضع ملصق أو علامة مائية يمكن الضغط عليها لرؤية تاريخ الصورة بالكامل.

تواجه عملية تطبيق هذا البروتوكول على نطاق واسع تحديات عدة؛ أبرزها الحاجة لدمجه في مجموعة واسعة من الأجهزة والبرمجيات، بدايةً من الكاميرات، ومنصات تحرير الصور والفيديوهات، وصولًا إلى نماذج الذكاء الاصطناعي متعددة الوسائط. رغم إمكانية تطبيق البروتوكول على جميع أنواع الوسائط، بما فيها الفيديوهات والصور والتسجيلات الصوتية والنصوص، فتحقيق ذلك يتطلب وقتًا وجهدًا كبيرين.

لكن يكمن التحدي الأكبر في الحصول على موافقة وتعاون جميع الشركات المعنية لتطبيق هذا البروتوكول. كما يتطلب الأمر دعمًا من منصات التواصل الاجتماعي ومختلف المنصات المختصة بتبادل المعلومات والوسائط، وهو أمر قد يصعب تحقيقه في الواقع العملي.

كشفت ميتا عبر مدونتها أنها تعمل على تطوير أدوات للكشف عن محتوى الذكاء الاصطناعي، لكن هذه الأدوات لا تزال تفتقر إلى الدقة الكافية؛ ما يجعل التحايل عليها أمرًا ممكنًا. بالإضافة إلى ذلك، فإن عدم دمج هذه الأدوات في نظام الرسائل الخاصة، وهو المجال الذي تقع فيه معظم الجرائم الإلكترونية، يشكل ثغرة أمنية إضافية تحتاج إلى معالجة.

استجابةً لهذه التحديات، اقترحت ولاية كاليفورنيا مشروع قانون يلزم شركات التكنولوجيا بتصنيف المحتوى المنشأ بواسطة الذكاء الاصطناعي، وفقًا لرسائل من هذه الشركات حصل عليها موقع تك كرانش (TechCrunch). يتطلب مشروع القانون AB 3211 وضع علامات مائية في البيانات الوصفية «الميتا داتا» للصور ومقاطع الفيديو والمقاطع الصوتية المنتجة بالذكاء الاصطناعي، كما يلزم المنصات الكبرى بتصنيف هذا المحتوى بطريقة واضحة للمستخدمين العاديين. ودعمت شركات التحالف مثل ميكروسوفت وOpenAI وأدوبي مشروع القرار.

للمفارقة تضع الكثير من الشركات الميتا داتا على الصور بالفعل، ولكن معظم الناس لا يقرؤونها نظرًا لتخصص الفكرة.

الوجه المشرق للذكاء الاصطناعي

عزيزي القارئ؛ بعد وصولك إلى تلك الفقرة قد يبدو الذكاء الاصطناعي للوهلة الأولى كلعنة تطل برأسها على عالمنا، لكن الحقيقة تكشف عن وجه آخر مشرق لهذه التقنية الثورية. فلنستعرض معًا بعض الإسهامات الرائعة التي قدمها الذكاء الاصطناعي للبشرية في مجالات متنوعة.

في القطاع الطبي على سبيل المثال، برهن الذكاء الاصطناعي على قدرته الفائقة في تحليل الصور الطبية بدقة متناهية؛ إذ تتمكن خوارزمياته المتطورة من فحص صور الأشعة السينية والرنين المغناطيسي لاكتشاف علامات مبكرة لأمراض خطيرة كالسرطان؛ ما يفتح آفاقًا جديدة في مجال التشخيص المبكر والعلاج الفعال. وفي عالم الأعمال والإدارة، أحدث الذكاء الاصطناعي ثورة في عملية صنع القرار. فمن خلال تحليله للبيانات الضخمة، يستطيع كشف أنماط واتجاهات قد تخفى على العين البشرية؛ إذ تُمكّن هذه القدرة الشركات والأفراد من اتخاذ قرارات مدروسة بسرعة ودقة غير مسبوقتين؛ ما يعزز الكفاءة ويقلل من هامش الخطأ.

أما في مجال النقل، فقد ساهم الذكاء الاصطناعي في تطوير سيارات القيادة الآلية. تفتح هذه السيارات المتطورة، والمزودة بمنظومة متكاملة من الكاميرات وأجهزة الاستشعار والخوارزميات الذكية آفاقًا جديدة لتحسين السلامة المرورية وتقليل الازدحام، فضلًا عن توفير وسيلة نقل مستقلة لذوي الاحتياجات الخاصة.

وفي مجال الإنتاجية، حقق الذكاء الاصطناعي قفزات هائلة، فهو يعمل على تحسين العمليات وتقليص الوقت والموارد اللازمة لإتمام المهام؛ ما يؤدي إلى زيادة الكفاءة وخفض التكاليف وتحسين جودة المنتجات والخدمات. كما برز الذكاء الاصطناعي كأداة قوية في مكافحة الاحتيال، فبفضل قدرته على تحليل أنماط المعاملات وكشف الشذوذ، يمكنه تحديد الأنشطة المشبوهة في الوقت الفعلي؛ ما يتيح للمؤسسات اتخاذ إجراءات وقائية سريعة وفعالة.

وربما لا تنتهي القائمة، ونحتاج إلى مقالات أخرى فقط لنعدد مساهمة الذكاء الاصطناعي في كل قطاع منفردًا، يمكننا القول إن إسهامات الذكاء الاصطناعي تمتد لتشمل جميع مناحي الحياة، من الرعاية الصحية إلى التعليم، ومن الصناعة إلى الزراعة. فهو يقدم حلولًا مبتكرة للتحديات اليومية، ويفتح آفاقًا جديدة للتقدم والإبداع. ومع استمرار تطور هذه التقنية، نتطلع إلى مستقبل أكثر ذكاءً وكفاءة، يسخر فيه الإنسان قوة الذكاء الاصطناعي لخدمة البشرية وتحسين جودة الحياة للجميع.

دور الذكاء الاصطناعي في كتابتي للمقال

لعب الذكاء الاصطناعي دورًا محوريًا في تحسين جودة مقالي. استعنت به لصقل العديد من الجمل لتصبح أكثر انسيابية وجاذبية للقارئ. كما ساعدني في تكثيف المعلومات من خلال تلخيص التقارير المطولة، وتجاوز حواجز اللغة عبر خدمات الترجمة الدقيقة. وأحد أكثر الجوانب المثيرة كانت قدرته على استخلاص المعلومات الأساسية من الروابط التي قدمتها له.